Como Criar e Configurar Arquivos robots.txt no WordPress – Guia Completo

Para que seu site esteja bem posicionado nos resultados de pesquisa dos motores de busca (SERP), você precisa que os bots dos motores de busca explorem as páginas mais importantes dele. Sendo assim, ter um arquivo robots.txt WordPress bem estruturado vai ajudar a direcionar esses bots às páginas que você quer que eles indexem.

Neste artigo, você vai aprender uma série de tópicos. São eles:

- O que é um arquivo robots.txt e por que ele é importante.

- Onde o arquivo robots.txt WordPress está localizado.

- Como criar um arquivo robots.txt.

- Quais regras inclui no seu arquivo robots.txt WordPress.

- Como testar o arquivo robots.txt e incluí-lo no Google Search Console.

Ao final do nosso conteúdo, você terá tudo o que é preciso para criar e configurar um arquivo robots.txt WordPress para seu site. E, com isso, aumentar as suas chances de aparecer nas melhores colocações dos motores de busca.

Conteúdo

O Que É um Arquivo robots.txt WordPress (e Por Que Você Precisa Dele)?

Quando você cria um novo site, os motores de busca enviam bots de reconhecimento para rastreá-lo e identificar todas as páginas que ele tem.

Dessa maneira, eles vão saber quais páginas mostrar nos resultados de busca quando alguém procura por palavras-chaves relacionadas ao tema do site. É simples assim.

O problema é que os sites mais modernos contêm muito mais elementos do que apenas páginas.

O WordPress, por exemplo, permite que você instale plugins, que têm seus próprios diretórios. Você não quer que eles apareçam nos resultados de pesquisa, pois eles não são exatamente um conteúdo muito relevante.

O que o arquivo robots.txt faz é fornecer um conjunto de instruções aos bots dos motores de busca. Ele meio que diz assim : “Ei, você pode olhar essas páginas aqui, mas não vá para aquelas páginas ali!”.

Esse arquivo pode ser tão detalhado quanto você quiser que ele seja. E é bem fácil criá-lo, mesmo que você não tenha muitos conhecimentos técnicos.

Na pŕatica, os motores de busca vão explorar o seu site mesmo que você não tenha um arquivo robots.txt configurado. Entretanto, não criar um arquivo deste tipo é algo ruim para seu site.

Sem ele, você permite que esses bots indexem todo o conteúdo do seu site. E eles são tão detalhistas que pode ser que eles acabem mostrando partes do seu site que você não quer que as pessoas acessem.

Mais importante do que isso, sem um arquivo robots.txt, você terá muitos bots perambulando pelo seu site. E isso por comprometer o desempenho dele em velocidade de carregamento e também no servidor de acesso.

Mesmo que o impacto seja insignificante, o carregamento de página é algo que sempre deve estar na sua lista de prioridades. Afinal, um site lento é algo que as pessoas costumam odiar a ponto de nunca mais acessarem um site novamente.

Onde o Arquivo robots.txt WordPress Está Localizado?

Quando você criar um site WordPress, ele automaticamente configura um arquivo robots.txt virtual localizado na pasta principal do seu domínio.

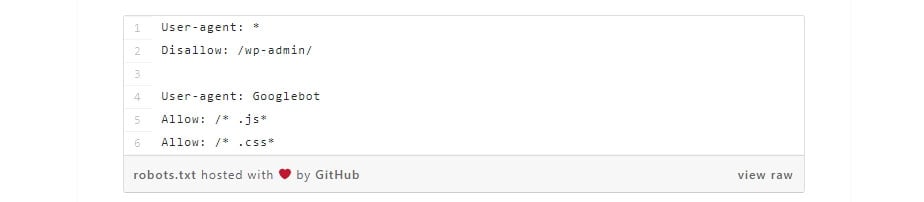

Por exemplo, se seu site está localizado no domínio seusitefalso.com.br, você vai conseguir encontrar o endereço seusitefalso.com.br/robots.txt. E também vai poder ver que um arquivo como este vai aparecer:

User-agent: * Disallow: /wp-admin/ Disallow: /wp-includes/

Esse é um exemplo de um arquivo robots.txt bem básico. De um ponto de vista mais claro, a parte logo depois de User-agent: declara em quais bots as regras logo abaixo se aplicam.

Um asterisco significa que as regras são universais e são aplicadas a todos os bots. Neste caso em específico, o arquivo robots.txt diz aos bots que eles não podem ir aos diretórios wp-admin e wp-includes.

E isso faz muito sentido, pois esses dois diretórios têm muitos arquivos delicados. E não é muito indicado que outras pessoas, além do dono do site WordPress, tenham acesso a eles.

Entretanto, pode ser que você queira adicionar mais regras ao seu próprio arquivo robots.txt. Antes de fazer isso, você vai precisar entender o que é um arquivo virtual.

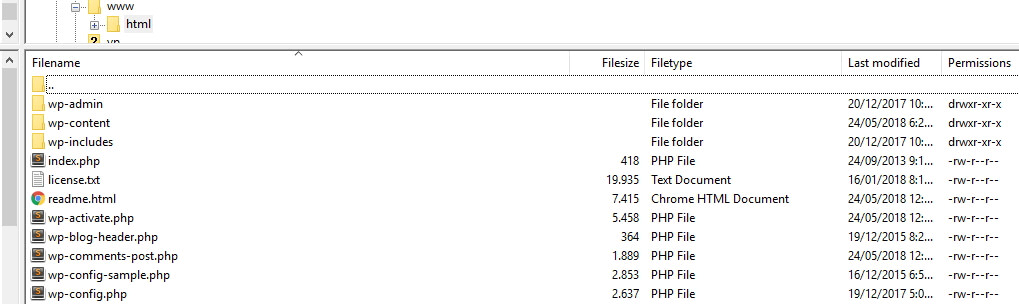

Normalmente, a localização do robots.txt WordPress está dentro do diretório root (raiz). Esse diretório é frequentemente chamado de public_html ou www (ou tem o nome do seu próprio site).

Só que o arquivo robots.txt que o WordPress configura para você por padrão não está acessível em nenhum diretório. Ele funciona, mas se você quiser fazer alterações, vai precisar criar seu próprio arquivo e enviá-lo para sua pasta root (raiz) como um substituto.

Vamos mostrar algumas maneiras de criar novos WordPress robots.txt em até um minuto. É bem fácil e rápido. Mas, por enquanto, vamos focar em como determinar quais regras você deveria incluir em um arquivo robots.txt WordPress.

Quais Regras Incluir no Seu Arquivo robots.txt WordPress?

Na seção passada, você viu um exemplo de arquivo robots.txt WordPress gerado no próprio CMS. Ele tinha apenas duas regras bem curtas.

Mas a maioria dos sites atualmente têm muito mais do que isso. Vamos dar uma olhada em dois arquivos robots.txt e mostrar o que ambos fazem de diferente um do outro.

Aqui está nosso primeiro exemplo de arquivo robots.txt WordPress:

User-agent: * Allow: / # Disallowed Sub-Directories Disallow: /checkout/ Disallow: /images/ Disallow: /forum/

Esse é um arquivo robots.txt genérico de um fórum de um site. Os motores de busca frequentemente indexam os tópicos dentro destes fóruns. Mas, dependendo sobre o quê o seu fórum for, pode ser que você não queira permitir isso.

Desta maneira, o Google não vai indexar centenas de tópicos em que os usuários mal interagem. Em vez disso, você pode aplicar regras para determinar que os robôs do Google indexem apenas os tópicos mais importantes e passem longe dos menos importantes.

Você também deve ter percebido a linha Allow: / logo no começo do arquivo. Essa linha determina que os bots varram todas as páginas de um site, menos as que aparecem especificadas logo abaixo dela.

Além disso, você perceberá que definimos essas regras como universais (com um ponto asterisco, assim como o arquivo robots.txt WordPres virtual.

Agora, vamos ver outro exemplo de um arquivo robots.txt WordPress:

User-agent: * Disallow: /wp-admin/ Disallow: /wp-includes/ User-agent: Bingbot Disallow: /

Nesse arquivo, colocamos as mesmas regras que o WordPress põe como padrão. Entretanto, também adicionamos um novo conjunto de regras que bloqueia o bot de busca do navegador Bing, o Bingbot, de explorar o seu site.

Você pode ser bem específico no que quer que os bots dos motores de buscam tenham acesso ao seu site. Na prática, é claro, o Bingbot é benígno (mesmo que ela não seja tão legal quanto o Googlebot). Ainda assim, esteja avisado que existem bots maliciosos por aí.

A má notícia é que os bots nem sempre seguem as regras ou instruções que você põe nos arquivos robots.txt (eles são meio rebeldes, digamos assim).

Tenha em mente que a maioria dos bots vão seguir as instruçõe que você determinar em um arquivo robots.txt. Você não estará os forçando a fazer isso, mas apenas pedindo gentilmente para seguirem as suas regras.

Se você se informar mais sobre o assunto, você vai encontrar muitas sugestões sobre o quê permitir e o que bloquear no seu site WordPress.

Contudo, pela nossa experiência, podemos recomendar algumas regras que funcionam melhor. Abaixo está um exemplo do quê fazer no seu primeiro arquivo robots.txt WordPress:

User-Agent: * Allow: /wp-content/uploads/ Disallow: /wp-content/plugins/

Tradicionalmente, o WordPress gosta de bloquear o acesso aos diretórios wp-admin e wp-includes. Entretanto, essa não é mais considerada uma boa prática.

Além disso, se você adicionar metadados nas suas imagens para fins de SEO (Search Engine Optimization), não faz muito sentido de proibir os bots de encontrarem essa informação.

Em vez disso, as duas regras acima cobrem o que a maioria dos sites mais básicos exigem quanto a serem encontrados nos motores de busca.

Como Criar um Arquivo robots.txt WordPress (3 Métodos)

Assim que decidir o que vai ser incluído no seu arquivo robots.txt, tudo o que resta agora é aprender como criar robots.txt WordPress. Você pode fazer isso usando um plugin específico ou manualmente.

Mas não se preocupe. Não é difícil. Mostraremos o passo a passo a seguir e ensinaremos você a usar dois dos mais populares plugins para eles fazerem isso para você. Além de também ensiná-lo a fazer por conta própria, sem depender de ferramentas. Vamos lá!

1. Use o Yoast SEO

O Yoast SEO praticamente nem precisa de introdução. Ele é o plugin de SEO para WordPress mais popular que existe. Ele permite que você otimize suas páginas e postagens para fazer um melhor uso das palavras-chaves que você escolher.

Além disso, o Yoast SEO ajuda você a otimizar melhor os seus conteúdos quando o assunto é legibilidade. Assim, seus leitores fazem uma leitura mais dinâmica e se apropriam melhor dos assuntos que você abordar.

Pessoalmente, somos fãs do Yoast SEO devido à sua facilidade de uso. Isso também se aplica ao processo de criar arquivos robots.txt.

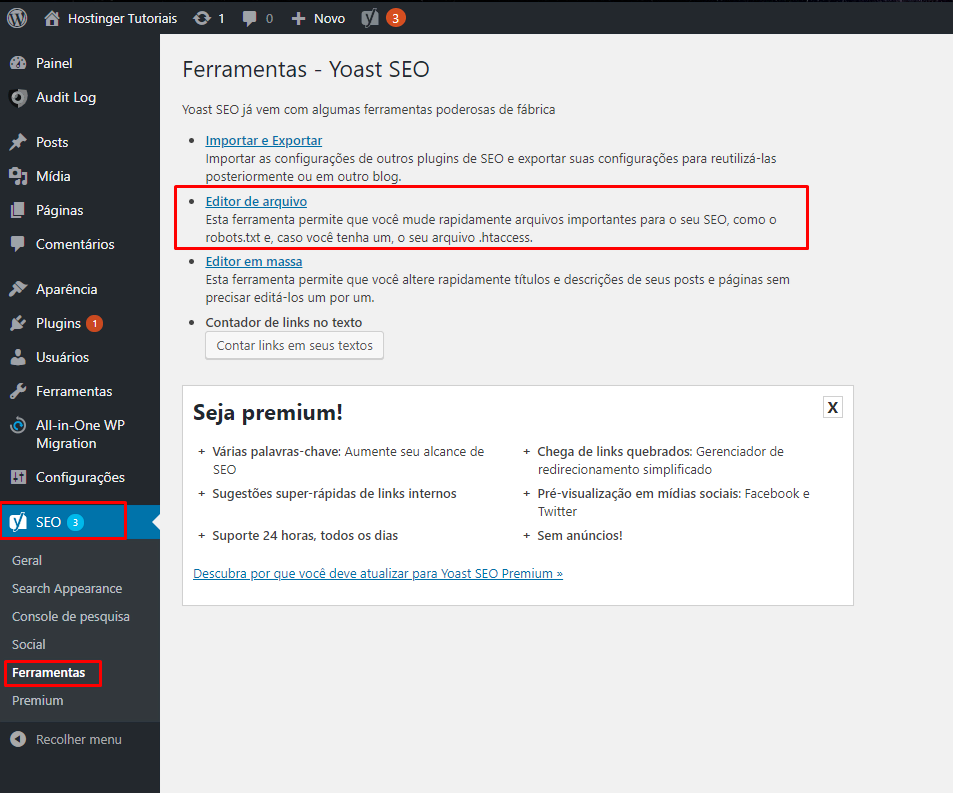

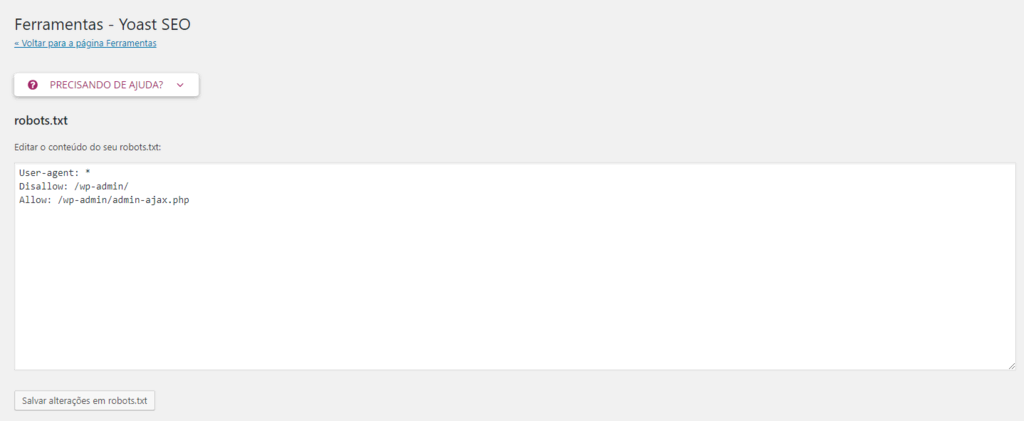

Assim que instalar e ativar o plugin Yoast SEO, navegue até SEO → Ferramentas no seu painel de controle e procure pela opção Editor de Arquivo:

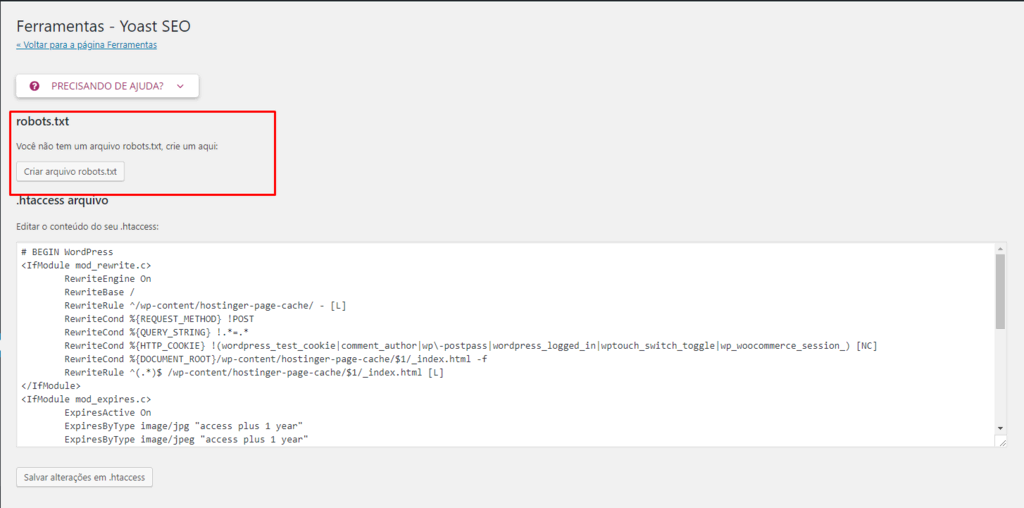

Clique nela e você será levado a uma nova página. Nela, você poderá editar o seu arquivo .htaccess sem sair do painel de controle do seu site WordPress. Também tem um botão bem útil chamado Criar arquivo robots.txt, que faz exatamente o que se espera dele.

Quando clicar nesse botão, um novo editor vai abrir e você poderá modificar diretamente seu arquivo robots.txt. Tenha em mente que o Yoast SEO possui suas próprias regras por padrão, que substituem o arquivo robots.txt virtual existente.

Sendo assim, para adicionar ou remover regras, lembre-se de clicar no botão Salvar alterações em robots.txt para garantir que as mudanças sejam aplicadas.

É simples assim! Agora vamos ver como outro plugin popular faz exatamente a mesma coisa.

2. Use o Plugin All in One SEO Pack

O plugin All in One SEO Pack é outro nome importante no WordPress quando estamos falando de SEO. Ele tem a maioria das funções que o Yoast SEO tem, mas algumas pessoas preferem usá-lo por ele ser um plugin bem leve.

Como estando querendo criar robots.txt WordPress, esse plugin faz exatamente o que o Yoast SEo faz sem perder a simplicidade.

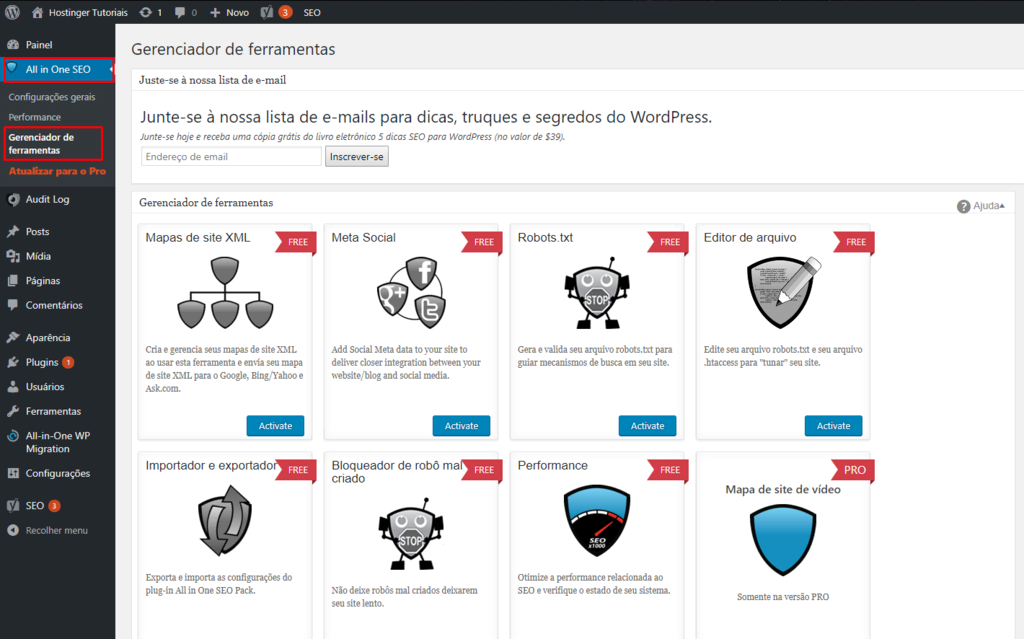

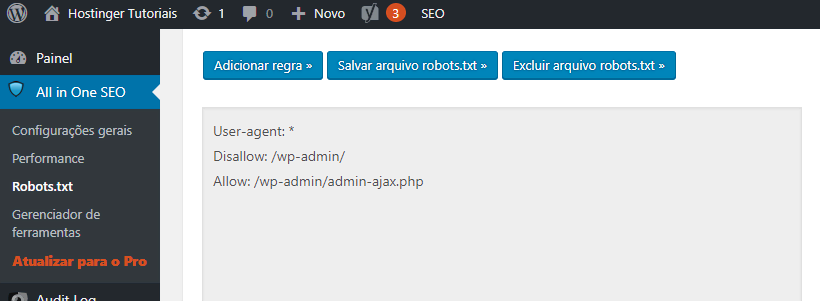

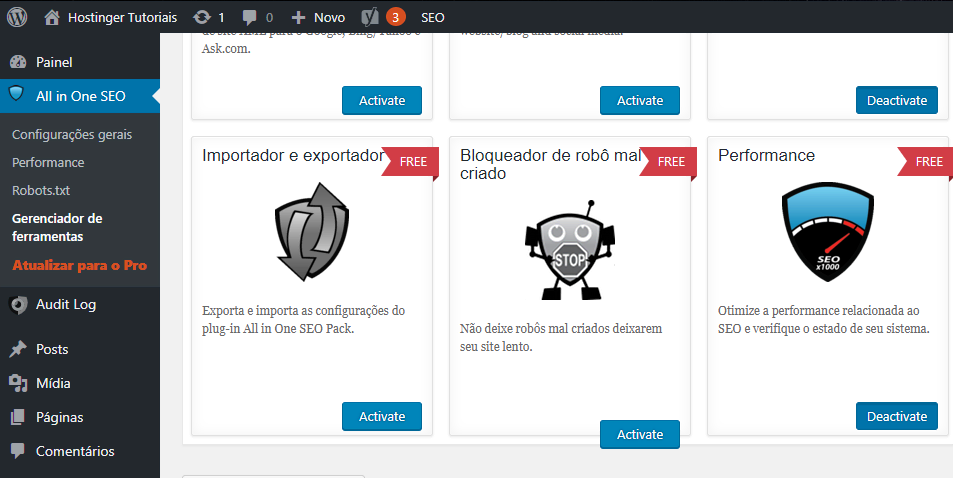

Assim que tiver instalado o plugin, navegue até a seção All in One SEO → Gerenciador de Ferramentas no próprio painel de controle do WordPress. Nela, você vai encontrar uma opção chamada Robots.txt acompanhada de um botão Activate (Ativar)logo abaixo. Clique nela.

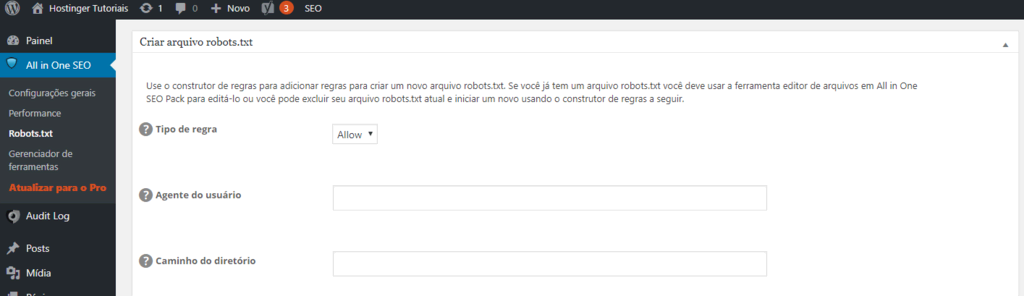

Agora, uma nova aba Robots.txt vai aparecer dentro do menu All in One SEO. Se você clicar nela, você vai ver novas opções de adicionar novas regras ao seu arquivo, salvar as mudanças que fizer ou deletá-las, se assim preferir.

Só se atente ao fato que você não pode fazer mudanças diretamente no seu arquivo robots.txt usando esse plugin. Nesta situação, ele é um pouco diferente do Yoast SEO, que permite escrever e editar o que você quiser no arquivo.

De qualquer forma, adicionar uma nova regra é simples, então não deixe esse detalhezinho atrapalhar você. Mais importante que isso, o plugin All in One SEO Pack também inclui um recurso de bloquear bots maliciosos, que você pode acessar dentro da aba All In One SEO.

Isso é tudo o que você precisa fazer se você escolher este método. Agora, chegou a hora de você aprender como criar um arquivo robots.txt WordPress manualmente.

Essa opção serve muito bem se você não estiver muito a fim de usar um plugin para tomar conta desse processo para você.

3. Crie e Faça Upload do Seu Arquivo robots.txt WordPress Pelo FTP

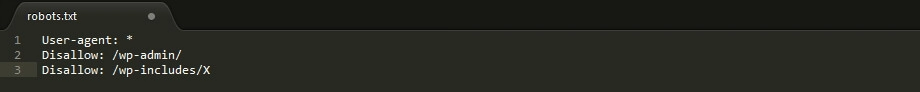

Criar um arquivo txt é extremamente fácil. Tudo o que você precisa fazer é abrir seu editor de textos favorito (como o Notepad ou o TextEdit) e escrever algumas linhas.

Depois disso, basta salvar o arquivo, usando qualquer nome e tipo de arquivo txt que quiser. Literalmente leva alguns segundos para fazer isso, então faz sentido que você queira criar um arquivo robots.txt WordPress sem usar um plugin.

Veja um rápido exemplo de um arquivo deste tipo criado manualmente.

Para o propósito deste tutorial, salvamos este arquivo de texto no nosso computador. Assim que seu arquivo for criado e salvo, você precisará se conectar ao seu site pelo FTP.

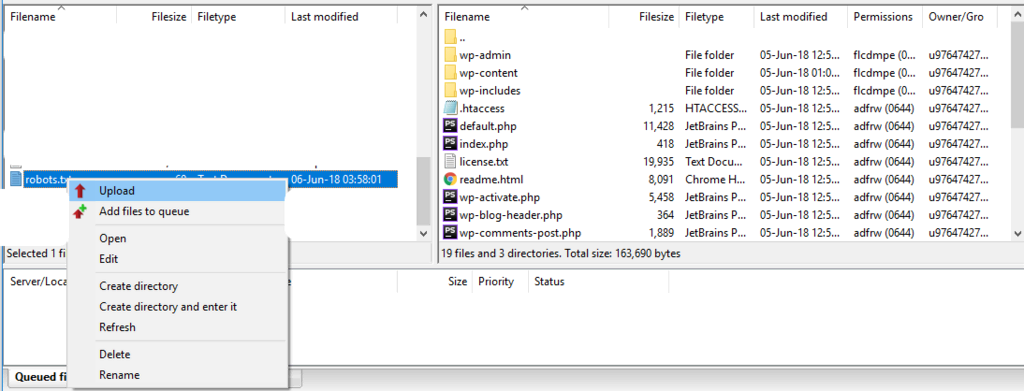

Se você não tem certeza de como fazer isso, temos um guia de que pode ajudar você a como configurar o cliente FileZilla.

Assim que se conectar ao seu site, navegue até a pasta public_html. Então, tudo o que você precisa fazer agora é o upload do seu arquivo robots.txt do seu computador para o seu servidor.

Você pode fazer isso de duas maneiras: clicando com o botão direito do mouse no arquivo usando o navegador local do seu cliente FTP ou simplesmente arrastando o arquivo para lá. Assim:

Deve levar apenas alguns segundos para o upload do arquivo ser completado. Como você pode ver, esse método é quase tão simples quanto usar um plugin específico.

Como Testar Seu Arquivo robots.txt WordPress e Enviá-lo para o Google Search Console

Quando você criar seu arquivo robots.txt WordPress fizer o upload dele para seu site, você pode usar o Google Search Console para testá-lo e encontrar possíveis erros.

O Google Search Console é uma coleção de ferramentas que oferecem ajuda para você monitorar como seu conteúdo aparece nos resultados dos motores de busca.

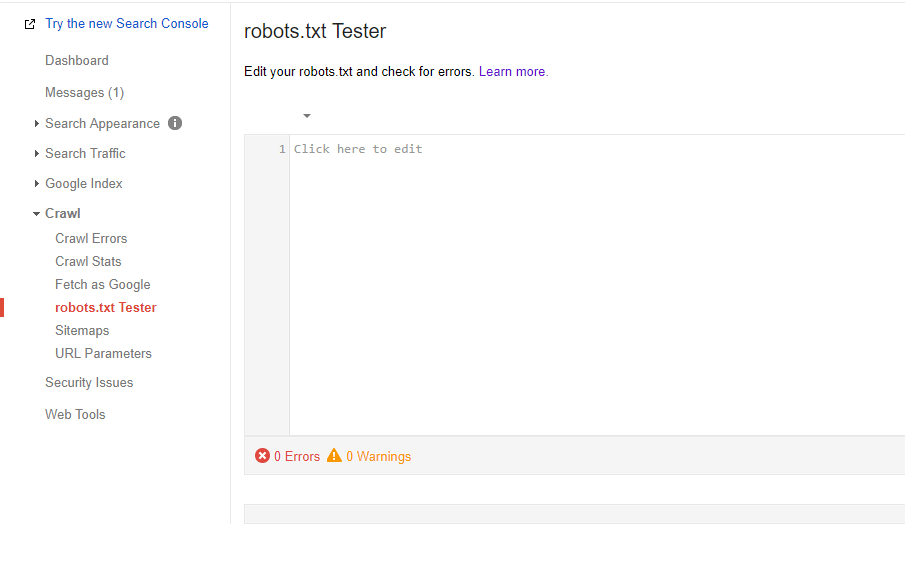

Uma dessas ferramentas é verificador de robots.txt, que você pode usar assim que fizer login no seu console e navegar até a aba robots.txt Tester.

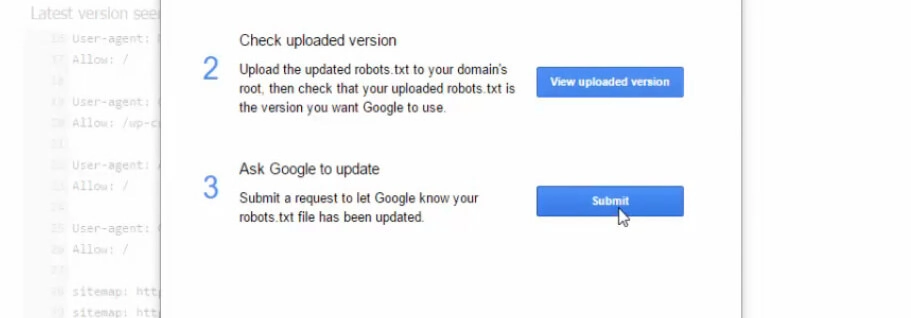

Dentro, você vai encontrar um campo de edição em que você vai poder adicionar o código do seu arquivo robots.txt WordPress. A partir daqui, clique no botão Submit (Enviar), como mostramos abaixo.

O Google Search Console vai perguntar se você quer usar o novo código ou removê-lo do seu site. Apenas clique na opção Ask Google to Update (Pedir ao Google para Atualizar) para enviá-lo manualmente.

Agora, a plataforma vai verificar se seu arquivo tem erros. Se houver algum, ela vai dizer exatamente qual é.

Entretanto, você já viu alguns exemplos de arquivos robots.txt WordPress neste artigo, então é bem provável que seu código não tenha nenhum problema.

Conclusão

Quem é que não quer aparecer e ser encontrado na internet? Para melhorar a exposição do seu site pela web, você precisa garantir que os bots dos motores de busca encontrem as informações mais relevantes do seu site.

Como vimos neste artigo, um arquivo robots.txt WordPress bem configurado permite que você determinar exatamente como esse bots interagem com o seu site. Dessa maneira, você consegue definir que os usuários tenham acesso a conteúdos mais úteis e relevantes.

Tem alguma pergunta ou dúvida que sobre como usar, editar e configurar robots.txt para WordPress? Saiba que podemos te ajudar! Entre em contato com a gente pela caixa de comentários abaixo!

Comentários

agosto 18 2018

Muito boa sua explicação. Recentemente criei um blog no Wordpress e ele passou a indexar muitas paginas. se eu pesquisar no google "site:comoseryoutuber.com.br" Aparece muitos resultados. Mais de 1000. OS resultados começão em " Index of /wp-content/plugins". então qual seria a melhor opção? bloquear todo Wp-content menos o upload? segunda duvida é: eu criado meu robots.txt, esses resultados que já foram indexados somem ou não ? vocês tem algum modelo ai que posso utilizar no meu blog?

agosto 30 2018

Oi, Diogo. Para sua primeira pergunta, você precisa fazer o bloqueio para cada página que quer desindexar. E quanto a segunda questão, os resultados indexados não vão sumir, só os que você bloquear no robots.txt ;)

agosto 25 2018

Muito bom. Obrigado pelas explicações! Eu estou configurando um site e ele já estava com o básico do robots.txt. Aí eu acrescentei o Allow: / Espero que funcione.

agosto 29 2018

Não precisa agradecer, Reginaldo! Espero que dê tudo certo por aí ;)

setembro 18 2018

Bom dia, tudo bem? Ao invés de especificar os acessos, criei um robots em branco e coloquei na raiz do domínio. Essa seria a melhor forma para ficar entre os primeiros? Grato Abraço William

julho 12 2019

Super obrigada, me ajudaram bastante.

setembro 04 2019

Conteúdo bem explicado, obrigada! ;D

dezembro 01 2020

Tutorial excelente! Muito obrigado!

dezembro 07 2020

Obrigado Cássio! É sempre um prazer ajudar :D